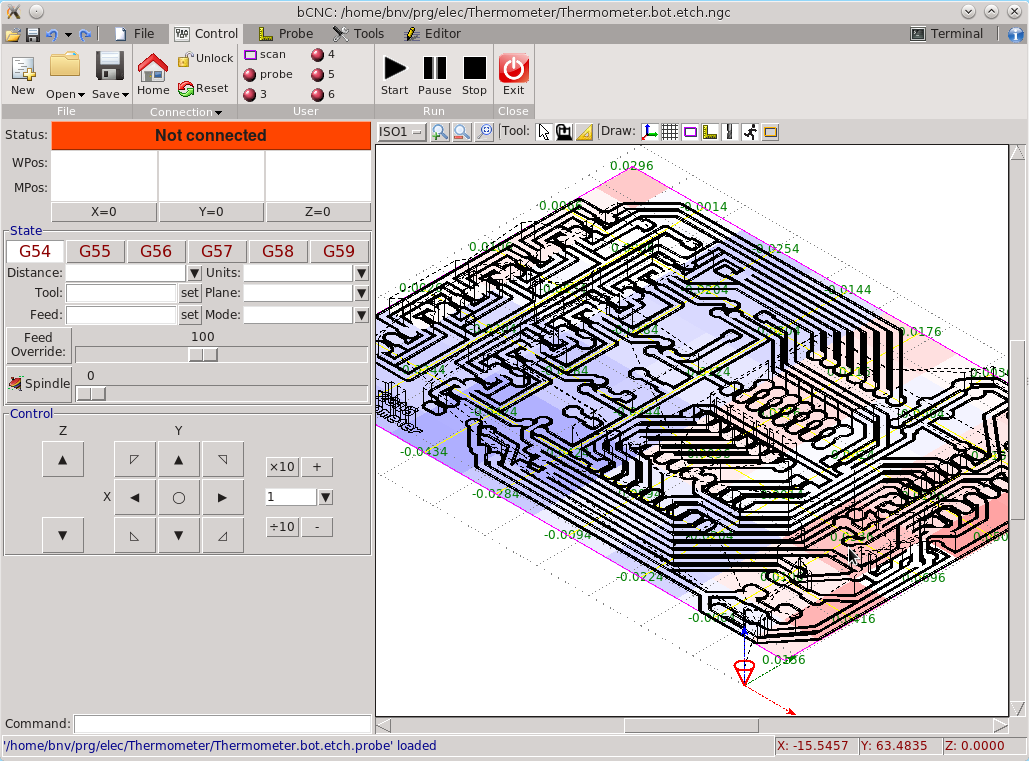

現在Bluetoothで、MacBook上のbCNCからCNCマシンを操作しています。同時にbCNCのPendant機能でスマホからも操作ができるので便利です。

あとは、加工中の状況(特にレーザー加工/目に危険なので)をカメラで監視できればいいと思って、Webカメラを設置できないかと考えていました。

USBケーブルでCNCマシンとMacBookをつなげていれば、Webカメラ(USB接続)で監視が可能です。例えば、以下のようなもの、

USBエンドスコープ:

AliExpress.com Product - Waterproof 5m Mini USB Endoscope Inspection Camera 6 White LEDs 1/9 CMOS 7mm Lens Borescope Snake Tube Camera with P2PUSBエンドスコープ(内視鏡):750円(送料込み)、直径7mm、ケーブル5m長いケーブル先端に直径7mmのカメラがついており、CNCマシンに取り付けやすいと思います。加工スポットをズームアップして監視したいので、こんな感じがいいのですが、ワイヤレスではないのが少し残念。そうなると、以下のようなもの。

AliExpress.com Product - Waterproof 5m Mini USB Endoscope Inspection Camera 6 White LEDs 1/9 CMOS 7mm Lens Borescope Snake Tube Camera with P2PUSBエンドスコープ(内視鏡):750円(送料込み)、直径7mm、ケーブル5m長いケーブル先端に直径7mmのカメラがついており、CNCマシンに取り付けやすいと思います。加工スポットをズームアップして監視したいので、こんな感じがいいのですが、ワイヤレスではないのが少し残念。そうなると、以下のようなもの。

あとは、加工中の状況(特にレーザー加工/目に危険なので)をカメラで監視できればいいと思って、Webカメラを設置できないかと考えていました。

USBケーブルでCNCマシンとMacBookをつなげていれば、Webカメラ(USB接続)で監視が可能です。例えば、以下のようなもの、

USBエンドスコープ:

AliExpress.com Product - Waterproof 5m Mini USB Endoscope Inspection Camera 6 White LEDs 1/9 CMOS 7mm Lens Borescope Snake Tube Camera with P2PUSBエンドスコープ(内視鏡):750円(送料込み)、直径7mm、ケーブル5m長いケーブル先端に直径7mmのカメラがついており、CNCマシンに取り付けやすいと思います。加工スポットをズームアップして監視したいので、こんな感じがいいのですが、ワイヤレスではないのが少し残念。そうなると、以下のようなもの。

AliExpress.com Product - Waterproof 5m Mini USB Endoscope Inspection Camera 6 White LEDs 1/9 CMOS 7mm Lens Borescope Snake Tube Camera with P2PUSBエンドスコープ(内視鏡):750円(送料込み)、直径7mm、ケーブル5m長いケーブル先端に直径7mmのカメラがついており、CNCマシンに取り付けやすいと思います。加工スポットをズームアップして監視したいので、こんな感じがいいのですが、ワイヤレスではないのが少し残念。そうなると、以下のようなもの。 AliExpress.com Product - Free shipping! 6LED HD 720P 1M / 2M / 5M WiFi Endoscope Waterproof Inspection Camera for ios and Android PCWifiエンドスコープ:2571円(1m)、2713円(2m)、2929円(5m)、送料無料。Wifiモジュールがついているので便利そうです。Wifiモジュールから外せばUSBカメラとしても使えると思います。

AliExpress.com Product - Free shipping! 6LED HD 720P 1M / 2M / 5M WiFi Endoscope Waterproof Inspection Camera for ios and Android PCWifiエンドスコープ:2571円(1m)、2713円(2m)、2929円(5m)、送料無料。Wifiモジュールがついているので便利そうです。Wifiモジュールから外せばUSBカメラとしても使えると思います。全体がコンパクトなWifiカメラなら、

AliExpress.com Product - 20pcs Mini DV Wifi Camera Q7 Cam 720P HD DVR Wireless IP Camera Video With IR LED Pocket-Size Remote By Phone Wholesale

1840円(送料込み)幅23mm、高さ43mmくらいなのでCNCマシンのどこにでも設置できそうです。

AliExpress.com Product - 20pcs Mini DV Wifi Camera Q7 Cam 720P HD DVR Wireless IP Camera Video With IR LED Pocket-Size Remote By Phone Wholesale

1840円(送料込み)幅23mm、高さ43mmくらいなのでCNCマシンのどこにでも設置できそうです。 bCNCのカメラ機能:ひとつ気になるのは、bCNCにはOpenCVを使ったカメラ機能があり、パソコンとUSBカメラで接続していないと使えません。つまりWifiエンドスコープからbCNCには取り込めないということです。単なる監視として使うならWifiエンドスコープがとても便利そうですが、少し残念。

BluetoothカメラやワイヤレスUSB:そうなると、BluetoothカメラがあればワイヤレスかつbCNCにも取り込めるのではないかと探しましたが案外ない。Bluetoothも進化しているようですが、カメラなどのストリーミング映像には向いていないらしい。どちらかというとストリーミング映像はWifiが得意らしいです。通信速度の違いだと思います。Bluetooth3.0から通信速度が上がったので不可能ではないようですが、あまり機器類を見かけないし、当然安価にもならないはず。同様に、ワイヤレスUSBも数年前にはありましたが、下火になったようで、これも機器類を探すこと自体難しい。

やっぱりWifiカメラ:ワイヤレスのカメラといえば、現在はWifiが主流となってしまいます。例えば、スマホのカメラから、パソコンにwifiを通して映像を流すということも、アプリがあればすぐにできます。以前、スマホからパソコンに映像を送るだけなら、AirMoreというので簡単にできました。

パソコンのブラウザ上ではこんな画面。いわゆるスマホ画面のミラーリングという機能です。このほかにもスマホからいろんなデータ転送もできるので便利です。

スマホにアプリをインストールして、あとはパソコンのブラウザでWifi通信という感じです。

いくつかアプリを試しましたが、以下のIP Webcam(Android版)というアプリが便利そうでした。

これはタブレット(スマホも可)から流している映像をパソコンのブラウザ上で見ているところです。

操作画面は先ほどのAirMoreに比べるとシンプルです。このアプリはどちらかというとカメラに重点が置かれているようで、画質などいろんな設定が可能です。

解像度、前面背面カメラ切り替え、露出、ズーム、フォーカス、上下左右反転など様々なことがパソコンからも操作できます。また、ローカルネットワークだけでなく、外出先からも見る設定もできるようです。さらに便利なのは、

このように直接アクセス可能なアドレスが載っており、ストリーミング映像ならIPアドレス:ポート/videoというところへアクセスすればMJPEG、連続したJPEG画像取得するなら、IPアドレス:ポート/shot.jpgへアクセスということです。ブラウザで192.168.3.2:8080/shot.jpgにアクセスして見ると、

こんな感じで、シンプルに画像だけ取り出すことができます。これはJPEG画像ですが、画面を更新し続ければ動画にもなるようでした。おそらくスマホでの動画をブラウザからリクエストしてその都度最新画像を読み込んでいるということだと思います。

状況的にはこんな感じ。タブレットをバイスに立てかけています(はさみこんではいません)。ワイヤレスなので好きなところに置くことができますが、できれば本体に取り付けたい。映像については連続するJPEG画像なので、Pythonで読み込むプログラムも難しくなさそう。もしかしたらbCNCへも取り込めるかもしれないという可能性がアップしてきました。

Python-OpenCVで実験:bCNCはPythonで書かれているため、そしてbCNCのカメラ機能はOpenCVを使っているため、Python-OpenCVで先ほどのストーリミング画像を取り込めないか試して見ました。多少PythonもOpenCVも触ったことはあるのですが、基本的にどちらも初心者です。とりあえず、Python-OpenCVのGetting Startedから見てみることにしました。いくつかのチュートリアルがあり、まずは静止画像の読み込みと表示方法、そして動画の読み込みと表示方法という感じです。

import numpy as np import cv2 img = cv2.imread('messi5.jpg',0) cv2.imshow('image',img) k = cv2.waitKey(0) if k == 27: # wait for ESC key to exit cv2.destroyAllWindows() elif k == ord('s'): # wait for 's' key to save and exit cv2.imwrite('messigray.png',img) cv2.destroyAllWindows()どうやらcv2.imread()とcv2.imshow()でできるようです。画像ソースをcv2.imread()に入れればいいだけのようで、そのまま先ほどのhttp://192.168.3.2:8080/shot.jpgを入れてcv2.imshow()で表示しようとしたのですがダメです。

import numpy as np import cv2 cap = cv2.VideoCapture(0) while(True): # Capture frame-by-frame ret, frame = cap.read() # Our operations on the frame come here gray = cv2.cvtColor(frame, cv2.COLOR_BGR2GRAY) # Display the resulting frame cv2.imshow('frame',gray) if cv2.waitKey(1) & 0xFF == ord('q'): break # When everything done, release the capture cap.release() cv2.destroyAllWindows()VideoCaptureクラスの方でも試して見ると、やはりcv2.VideoCapture()にIPアドレスを入れてもエラーが出ます。Python2.7なのでOpenCV2.4を使用中。というのは、bCNCがPython3に対応していないため。どうやらOpenCV3にすれば、URLを入れても大丈夫らしい。惜しい。色々調べて見ると、OpenCV2.4ではネットワーク上の画像などを読み込むには、この方法ではダメらしい。

# coding: UTF-8

import cv2

import numpy as np

import urllib

import sys

ipAddress='http://192.168.3.2:8080/shot.jpg'

def readImg(ip):

req=urllib.urlopen(ip)

data=req.read()

byteData=bytearray(data)

arr=np.asarray(byteData, dtype=np.uint8)

return cv2.imdecode(arr,1)

while True:

img = readImg(ipAddress)

if len(img) > 0:

h, w = img.shape[:2]

halfImg = cv2.resize(img, (w/2,h/2))

cv2.imshow('IMAGE',halfImg)

else:

print 'no image'

sys.exit()

break

if cv2.waitKey(1) & 0xFF == ord('q'):

break

cv2.destroyAllWindows()

その後、いろいろエラー続出でかなり悩みましたが、なんとかIPカメラから画像を取り込んでPythonで表示することができました(上記コード)。たったこれだけのコードですが、外部から取り込んだデータをデコードする必要があるみたいで、その方法に気づくのに時間がかかり、なおかつ普通の読み込みではしないような手順があったり、一行ずつ確かめては書き直したりしていました。

追記: その後もPythonをいじってましたが、Pythonではdefの外側の変数(グローバル変数)は、def内にはそのままでは通らないようで、def内でglobalを書かないといけないということがわかりました。Pythonはちょっと癖があっていちいち調べないといけないので難しいです。

これはPython-OpenCVによる映像の読込み/表示画面。シンプルに映像だけ取り出せることができました。

*尚、このようなことを可能にするには、PythonのほかOpenCV、NumPyなどのインストールが必要です。

bCNCへ取り込み:

次は、これを元にbCNCのコードを改造していかなければなりません。bCNCのCamera.pyを開いて見ると、基本的にUSBカメラから映像を取り込んでいるためか、OpenCVのVideoCaptureを使っていました。これは先ほどの動画に関するチュートリアルでも見た方法ですが、今回はVideoCaptureを使わないで、映像(連続するJPEG画像)を取り込む方法(上のコード)でやりたいと思います。というか、その方法しかまだ知らないので。VideoCaptureを使ってMJPEGを取り込めれば簡単そうだけど、OpenCV2.4だと多分できない。 だいたいこの辺のQ&AサイトやGitのここなどを参考に試行錯誤していました。

追記: MPEGの場合、IPアドレス:ポート/video?.mpegにアクセスすればいいようで、このサイトに書いてありました。mpegやjpegは1フレームごとに開始マーカー、終了マーカーがあり、それを手掛かりにデータを読み取るようです。

これが、bCNCのCamera.pyの中身です。いろいろいじっている最中。当然バックアップは取ってあります。IPアドレスからの画像取り込みのため、手順が違ってちょっと面倒です。すぐエラーが出ます。

数時間後、とりあえず画像を取り込む所まではできました(やや強引に)。

もともと、bCNCのPendant機能でカメラ映像を他の端末でモニタリングできるのですが、それも可能でした。つまり、IPカメラ(スマホ)の映像をbCNCを通してMacBookに橋渡しさせ、また別の端末(タブレット)からMacBookのIPアドレスにアクセスして、その映像を見るということです。当然、映像配信元のIPカメラ(スマホ)のIPアドレスに直接アクセスして見ることもできます。

まだ、bCNC内の画像調整(画像サイズや角度)のパラメータとはつなげられていないので、きちんとは機能していません。 bCNCのProbe Camera Alignment(OpenCVを使った位置決め機能)を試したことはないのですが、できればこの機能にUSBカメラのみならずIPカメラも接続可能にして使えればと思っています。もう少しプログラムの改造には時間かかりそうです。というか、Pythonに慣れていないので、かなり疲れてきたという感じです。

予定としては:

・bCNCにおいてIPカメラからの映像を読み込めるようにする(現在ここ)

・読み込んだ映像のサイズや角度の調整ができるようにbCNCのパラメータにつなげる

・USBカメラとIPカメラの両方を使えるようにする

・USBカメラとIPカメラ切り替えボタンやIPアドレス入力欄をつくる

ここまでできれば便利だけど、かなりめんどくさそう。

IPカメラについて:

プログラムの方は少しずつ改造していきますが、IPカメラの方も考えています。とりあえず手っ取り早いのが、スマホやタブレットをCNCマシンのヘッド近くに置いておくことですが、できれば小型なカメラを設置したいと思っています。WifiといえばESP8266が安価なので、それにカメラモジュールをつけて、スピンドル先端付近に取り付けられるのが理想です。

AliExpress.com Product - V3 4 M bytes (32 Mbits) FLASH Lua NodeMcu placa de desarrollo de Redes WIFI Basado ESP8266 con firmwareESP8266:341円(送料込み)これに以下のようなカメラモジュールをつければ、Wifiカメラとして使えます。

AliExpress.com Product - V3 4 M bytes (32 Mbits) FLASH Lua NodeMcu placa de desarrollo de Redes WIFI Basado ESP8266 con firmwareESP8266:341円(送料込み)これに以下のようなカメラモジュールをつければ、Wifiカメラとして使えます。 AliExpress.com Product - New OV7670 VGA Camera Module Lens CMOS 640X480 SCCB w I2C Interface Auto Exposure Control Display Active384円(送料込み)これは前回調べましたが、AudCamのGitにArduino用ライブラリなどあります。あるいはInstructables。追記:どうやらこの安価なOV7670はFIFOなし(バッファメモリなし)らしく、接続してもかなり遅いフレームレートになるようです。FIFOありの以下のようなモジュールが扱いやすいと思います。

AliExpress.com Product - New OV7670 VGA Camera Module Lens CMOS 640X480 SCCB w I2C Interface Auto Exposure Control Display Active384円(送料込み)これは前回調べましたが、AudCamのGitにArduino用ライブラリなどあります。あるいはInstructables。追記:どうやらこの安価なOV7670はFIFOなし(バッファメモリなし)らしく、接続してもかなり遅いフレームレートになるようです。FIFOありの以下のようなモジュールが扱いやすいと思います。 AliExpress.com Product - High Quality with FIFO CMOS Camera Module OV7670 Sensor Module Microcontroller Collection Module

1374円(送料無料)、FIFOつきOV7670カメラモジュール。

AliExpress.com Product - High Quality with FIFO CMOS Camera Module OV7670 Sensor Module Microcontroller Collection Module

1374円(送料無料)、FIFOつきOV7670カメラモジュール。 AliExpress.com Product - Free shipping ESP32-T Shield ESP32-Bit Development Board Compatible For ESP-32S Bluetooth WiFi Module ESP32S Wireless Board810円(送料込み)、追記:これはシールドだけでした。さらにこのESP32はWifiだけでなくBluetoothもついているようなので、もしかするとBluetoothカメラも可能かもしれません。ESP8266の上位機種といったところ。少し高価ですが、スペックに対してはかなり安い。秋月にもチップだけ700円で売っています。

AliExpress.com Product - Free shipping ESP32-T Shield ESP32-Bit Development Board Compatible For ESP-32S Bluetooth WiFi Module ESP32S Wireless Board810円(送料込み)、追記:これはシールドだけでした。さらにこのESP32はWifiだけでなくBluetoothもついているようなので、もしかするとBluetoothカメラも可能かもしれません。ESP8266の上位機種といったところ。少し高価ですが、スペックに対してはかなり安い。秋月にもチップだけ700円で売っています。IPカメラ化についてはまた作業が進んだら報告します。

memo:・Reading and Writing images and Video(OpenCV)・python-opencv-ipcam.py・To get mjpeg from "http://192.168.3.2:8080/video?.mjpeg" ・To get images from "http://192.168.3.2:8080/video?action=stream" pip install requests